Cómo detectar imágenes de guerra falsas después de los ataques de Estados Unidos contra instalaciones nucleares iraníes

Los manifestantes portan carteles y ondean una bandera iraní mientras se concentran frente a la Casa Blanca el domingo 22 2025 de junio en Washington para protestar por el ataque militar estadounidense contra tres sitios en Irán la madrugada del domingo. (Foto AP/José Luis Magaña)

Los manifestantes portan carteles y ondean una bandera iraní mientras se concentran frente a la Casa Blanca el domingo 22 2025 de junio en Washington para protestar por el ataque militar estadounidense contra tres sitios en Irán la madrugada del domingo. (Foto AP/José Luis Magaña)Las imágenes y videos de explosiones, incendios, protestas y armas se volvieron virales después de los ataques de Estados Unidos el 21 de junio contra tres sitios nucleares iraníes, pero muchos de ellos no mostraban lo que realmente estaba sucediendo.

En cambio, fueron generados por inteligencia artificial sacada de contexto o grabada desde videojuegos o simuladores de vuelo. Muchos de ellos fueron compartidos por cuentas X con marcas de verificación azules que anteriormente estaban asociadas con cuentas que pertenecían a personas u organizaciones con identidades verificadas. (Ahora se pueden comprar).

Puede ser difícil saber a primera vista en las plataformas de redes sociales si los subtítulos que infunden miedo realmente se ajustan a la foto o al vídeo que ves; A veces, los programas de notas comunitarias añaden contexto, pero a veces no lo hacen .

PolitiFact verificó algunas de las imágenes y videos engañosos sobre el ataque estadounidense y su reacción. Aquí hay una guía sobre qué evitar y consejos sobre cómo verificar imágenes de conflicto.

Las imágenes generadas por IA a menudo contienen inconsistencias visuales

Una cuenta de cheque azul en X llamada Ukraine Front Line publicó un vídeo 22 de junio que muestra un rayo golpeando una columna de humo que estalla en una neblina ardiente. El título advertía sobre una guerra nuclear: ¡Por favor, presten atención al Rayo! Ésta es la señal más segura de que la explosión fue efectivamente nuclear.

freddie mercury kashmira cooke

Pero el video no muestra un evento real. fue subido 18 de junio en YouTube con el título ai video. El biografía de la cuenta lee Todos los videos de este canal están producidos con inteligencia artificial.

Algunos modelos de IA generativa permiten a las personas escribir indicaciones para generar vídeos realistas y los resultados son cada vez más sofisticados.

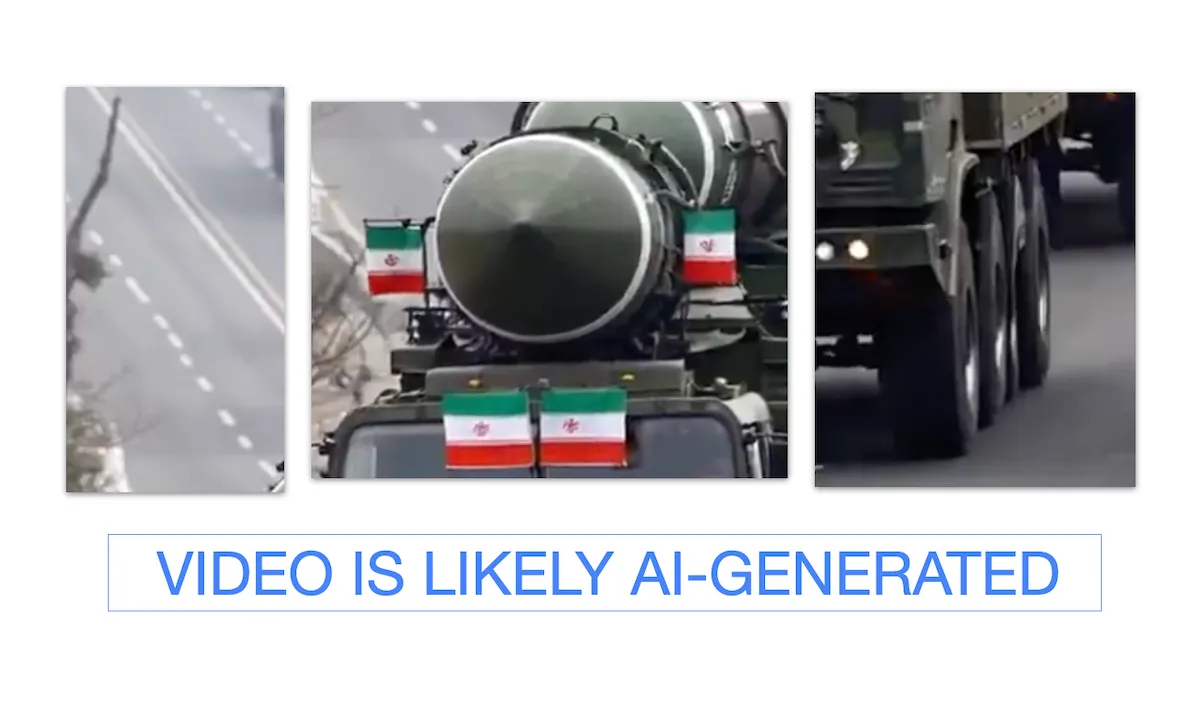

Pero no son perfectos y mirar los videos de cerca frecuentemente revelará inconsistencias visuales. un vídeo La leyenda Preparándose para el ataque (de esta noche) mostraba camiones con banderas iraníes que transportaban misiles. Una mirada más cercana mostró que las líneas en la carretera eran desiguales, un neumático del segundo camión parecía tener un trozo arrancado y los caracteres en las banderas tampoco coincidían con la bandera iraní real.

(Capturas de pantalla/X)

Hany Farid, profesor de UC Berkeley que se especializa en ciencia forense digital escribió en LinkedIn que muchos vídeos generados por IA suelen durar ocho segundos o menos o se componen de clips de ocho segundos editados juntos. eso es porque Google’s Veo 3 un modelo de texto a vídeo tiene un límite de ocho segundos. Algunos vídeos tienen marcas de agua visibles, pero los usuarios pueden recortarlas.

Históricamente, los medios tergiversados han sido más prominente que las imágenes de IA durante las últimas noticias. Pero durante esta guerra, tanto las cuentas proisraelíes como las proiraníes han compartido imágenes de IA. Emmanuelle Saliba, directora de investigación de la empresa de análisis forense digital Get Real Labs, dijo BBC verificar Fue la primera vez que vimos el uso de IA generativa a escala durante un conflicto.

Los desinformadores siguen compartiendo imágenes y vídeos antiguos fuera de contexto

Además del uso cada vez mayor de la IA por parte de desinformadores, no han faltado imágenes y vídeos compartidos en el contexto equivocado.

Estallan protestas masivas en todo Estados Unidos cuando los ciudadanos salen a las calles indignados después de que Estados Unidos lanza un ataque contra Irán. 22 de junio X publicación leer. Pero el video fue subido. 14 de junio El día de las protestas No Kings en todo el país.

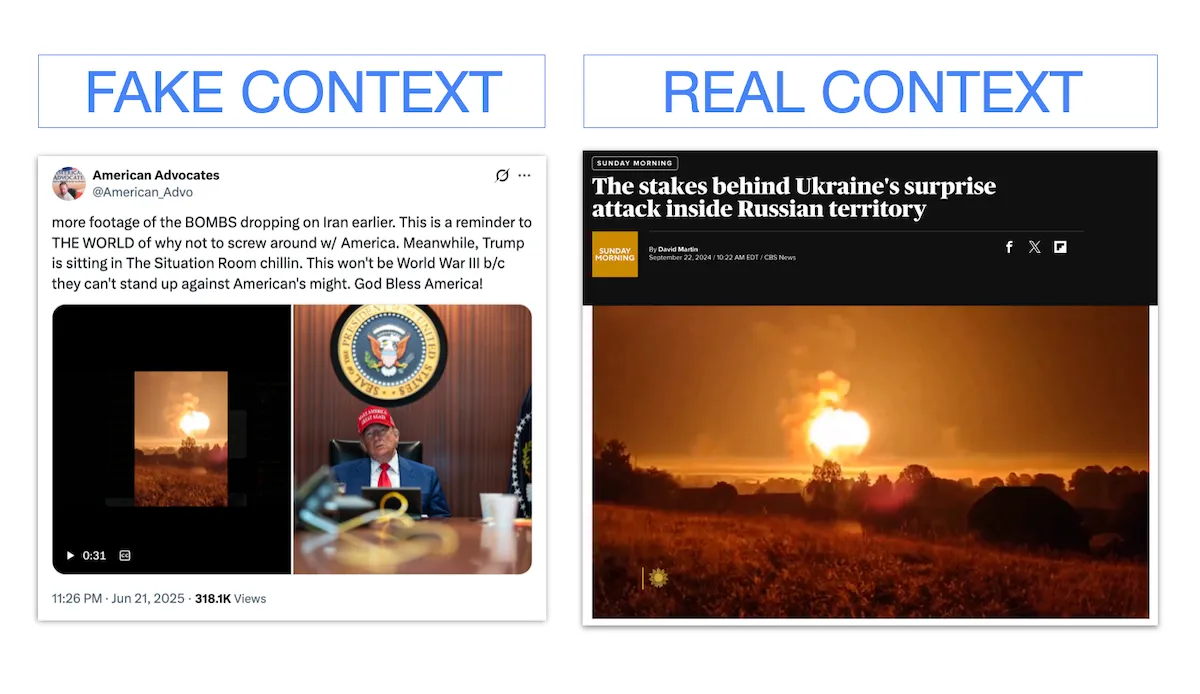

Otro vídeo de X compartido la noche de los ataques estadounidenses mostraba una gran columna de fuego y humo. Más imágenes de las BOMBAS cayendo sobre Irán anteriormente leen el título de vídeo . Pero eso es falso; el video vino de un 2024 Ataque ucraniano a Rusia .

(Capturas de pantalla/X CBS News)

Una búsqueda inversa de imágenes puede revelar si un vídeo se publicó en línea anteriormente y cuál era el contexto original. Herramientas como Google Lens y TinEye pueden mostrar dónde se compartieron imágenes o videos en las plataformas, quién los publicó y cuándo se realizó la primera publicación. Los subtítulos de las imágenes publicadas por los medios de comunicación probablemente mostrarán cuándo y dónde fueron tomadas.

emma myers estatura

Imágenes de videojuegos extraídas de manuales de estrategias de conflictos anteriores

Las imágenes grabadas en simuladores de vuelo y videojuegos militares también tergiversan el conflicto.

¡Este es el bombardero furtivo B2 Spirit despegando en California! leer un 21 de junio X publicación por una cuenta de cheque azul antes del ataque a Irán.

Excepto que no era un bombardero B2 real. Verificar la marca de agua del video conduce a una cuenta de TikTok que publicó el video. 15 de mayo con el hashtag #microsoftflightsimulator un juego de simulación disponible en Xbox.

edad de asher angel

La jugabilidad del videojuego Arma también es susceptible de mal uso durante un conflicto armado . PolitiFact verificó las afirmaciones que utilizaron imágenes de Arma durante el Guerra Ucrania-Rusia y el Guerra entre Israel y Hamás .

Las búsquedas de palabras clave en plataformas de vídeo como YouTube pueden mostrar si los vídeos coinciden con imágenes de videojuegos que se han subido previamente.

Formas sencillas de analizar la confiabilidad de las cuentas

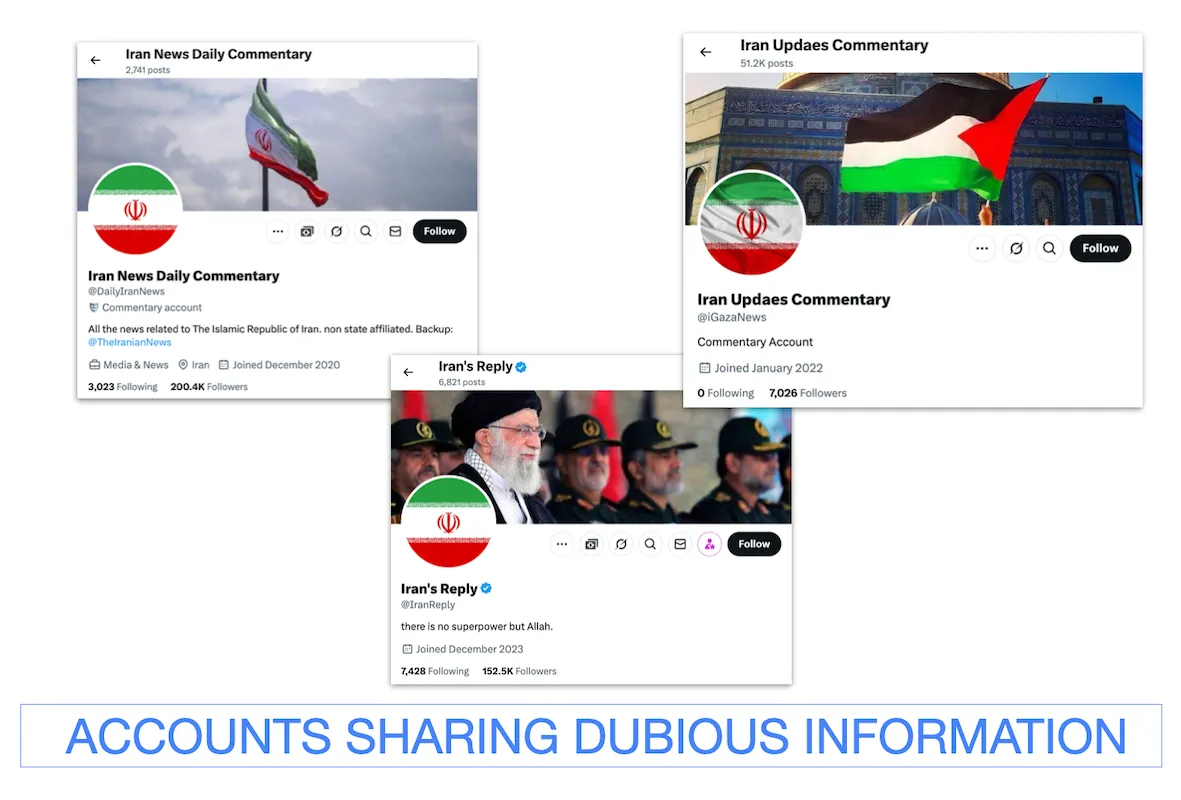

Verificar el perfil y la biografía de una cuenta a menudo revelará si es creíble o no. Muchas afirmaciones falsas y engañosas provienen de cuentas con la bandera iraní como foto de perfil y nombres para mostrar que pueden confundirse con actualizaciones de noticias legítimas.

Dichas cuentas incluyen el comentario Iran Updaes (incluido el error tipográfico) y el comentario diario de Iran News. Otra cuenta, con un cheque azul, se llama Respuesta de Irán.

(Capturas de pantalla/X)

Pero estos no están afiliados al gobierno iraní ni a ninguna fuente creíble. PolitiFact descubrió que publicaciones en estas cuentas ganar cientos de miles, si no millones, de visitas, pero contienen contenido de baja calidad, como imágenes generadas por IA. Esta verificación de hechos fue originalmente publicado por PolitiFact que forma parte del Instituto Poynter. Vea las fuentes para esta verificación de hechos. aquí .